Le fotocamere hanno potenzialità inaspettate e, se integrate con adeguato software, diventano strumenti capaci di competere con sistemi di gran lunga più costosi. Con modifica Full Range di Profilocolore, possono “vedere” dagli ultravioletti agli infrarossi per estendere il potenziale in diversi campi d’applicazione: dall'Arte alla Medicina, dall'Investigazione al monitoraggio dell'Ambiente.

Indici di rifrazione e percorsi ottici nella fotocamera

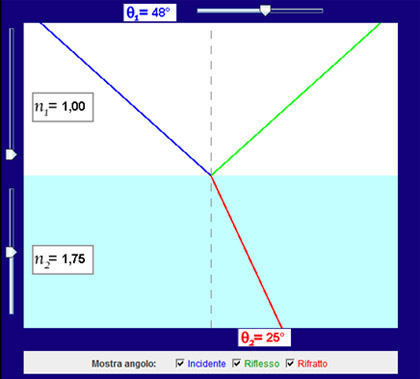

Tutta l'ottica presente sia nella fotocamera che, in modo massivo, negli obiettivi si basa sul fenomeno della rifrazione, ovvero sul fatto che la luce, passando da un mezzo ad una certa densità ad un altro con densità diversa (ad esempio aria/vetro) subisce una deviazione rispetto al percorso rettilineo, proporzionale al rapporto tra le densità dei due mezzi (o al rapporto tra i così detti indici di rifrazione dei due mezzi), ed all'angolo di incidenza con cui la luce colpisce la superficie di interfaccia. Il fenomeno è regolato da quella che va sotto il nome di Legge di Snell: n1sinθ1 = n2sinθ2 dove n indica l'indice di rifrazione.

|

|

|

Fenomeno della rifrazione: interfaccia piana - Simulatore -

|

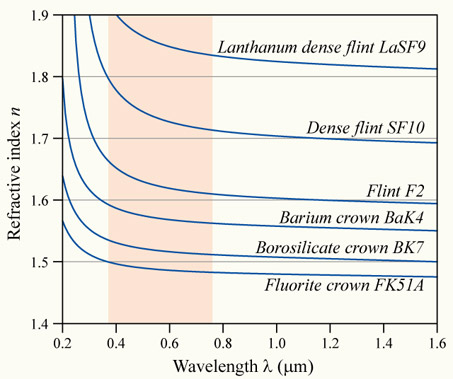

Indici di rifrazione dei vari materiali al variare della lunghezza d'onda

|

|

Figura 8: Rifrazione di un'onda elettromagnetica nel passaggio da un mezzo ad un altro

|

|

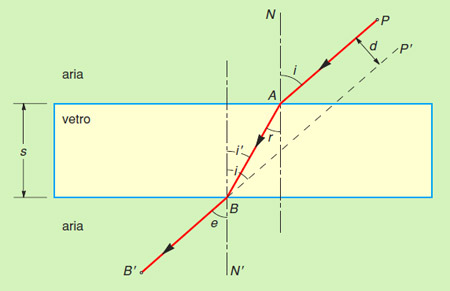

Il fenomeno della rifrazione ha una ripercussione importante quando la luce attraversa una lastra di vetro (optical window) perché il suo cammino non subisce una deviazione angolare ma uno spostamento parallelo.

La rimozione del filtro UV-IR cut sottrae al cammino ottico una componente importante che va ripristinata e che dipenderà da diversi fattori, non solo quelli della finestra ottica originale perché dovendo considerare ora una banda più larga si dovrà avere l'accorgimento di ripristinare il cammino ottico critico corrispondente alla messa a fuoco all'infinito nella massima lunghezza d'onda che attraverserà la lastra. La finestra ottica da impiantare al posto del filtro originale avrà quindi uno spessore che dipenderà da:

• nuovo indice di rifrazione rispetto a quello del filtro tolto

• lunghezza d'onda massima che deve attraversare la finestra ottica

• geometria dell'obiettivo a focale più corta che si vuole usare (determina gli angoli di incidenza sulla finestra ottica)

• tiraggio del corpo macchina

Tutti questi parametri vanno inseriti in una equazione trascendentale di non semplice soluzione. Una errata soluzione, può portare ad una modifica che impedisce la messa a fuoco all'infinito in certe situazioni, oppure al contrario ad una finestra ottica inefficiente o addirittura impossibile per gli ingombri richiesti.

|

angolo di ingresso i = angolo di uscita e i = e d =s*[(n-1)/n]*irad s = spessore della lastra d = spostamento del raggio n = indice di rifrazione relativo |

|

Spostamento di un raggio rifratto da lastra

|

Calcolo spostamento del raggio

|

Tutti questi parametri vanno inseriti in una equazione trascendentale di non semplice soluzione. Una errata soluzione, può portare ad una modifica che impedisce la messa a fuoco all'infinito in certe situazioni, oppure al contrario ad una finestra ottica inefficiente o addirittura impossibile per gli ingombri richiesti.

|

|

|

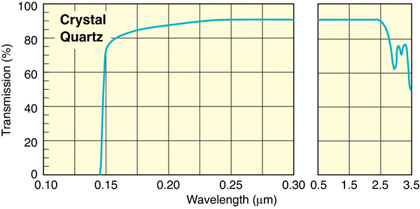

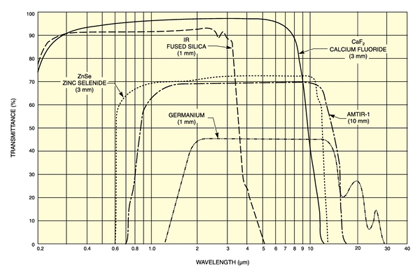

Trasmittanza del cristallo di quarzo

|

Trasmittanze di altri materiali

|

|

Figura 10: Trasmittanze di vari materiali per finestre ottiche

|

|

L'ultima considerazione che va fatta sulla finestra ottica con cui si sostituisce il filtro (o i filtri) originale riguarda le proprietà ottiche, cioè la qualità di fabbricazione. Soprattutto su una fotocamera come la Nikon D800/D800E dove i 36 milioni di pixel sono capaci di catturare qualsiasi infinitesimo dettaglio, non è pensabile utilizzare una finestra ottica qualsiasi o di bassa qualità.

Ci riferiamo ad almeno un paio di aspetti geometrici: il parallelismo tra le due facce della finestra e la levigatura. Entrambi devono essere ai massimi livelli. Ad esempio la politura delle superfici deve garantire asperità inferiori a lambda/4, dove lambda indica la lunghezza d'onda elettromagnetica che attraverserà la finestra (la luce, per intenderci). Considerando che la sensibilità arriva fino a 300 nanometri, le asperità della superficie non devono superare i 75 nanometri (1 nanometro = 1 miliardesimo di metro = 1 milionesimo di millimetro).

Qua abbiamo citato solo un paio di parametri che caratterizzano la qualità ottica di un qualunque dispositivo semplice. Una panoramica più ampia ed esaustiva può essere consultata sul sito della Edmund Optics.

DISPERSIONE

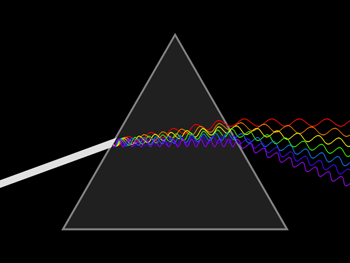

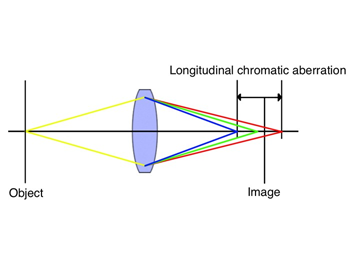

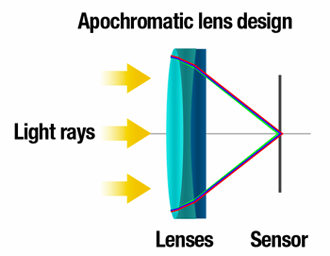

L'angolo di cui devia un'onda elettromagnetica (inclusa la luce) per rifrazione dipende anche dalla lunghezza d'onda stessa: maggiore è la lunghezza d'onda minore è la deviazione. Questo fenomeno, che viene chiamato dispersione, è responsabile della formazione dell'arcobaleno, ad esempio. Ma il fenomeno si presenta anche nel passaggio della luce in una lente semplice, creando la così detta aberrazione cromatica, ovvero l'impossibilità di trovare un unico piano di messa a fuoco dove convergano tutte le componenti cromatiche.

|

|

|

Dispersione della luce nel prisma

|

Aberrazione cromatica in una lente

|

|

Figura 11: Fenomeno della dispersione ed aberrazione cromatica

|

|

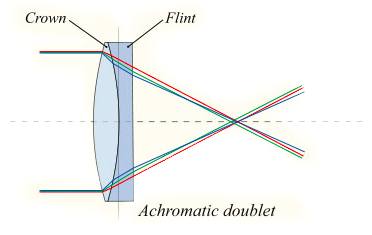

Negli obiettivi questo fenomeno di dispersione viene contrastato da particolari combinazioni ottiche costituite da due lenti di forma e materiale diversi, dette doppietti acromatici. La sigla ED, ad esempio, rilevabile su obiettivi Nikkor di Nikon è l'acronimo per Extremely low Dispersion, ovvero dispersione cromatica estremamente bassa.

|

|

|

Correzione acromatica (doppietto acromatico)

|

Correzione apocromatica

|

|

Figura 12: Correzione della dispersione cromatica negli obiettivi

|

|

COMPORTAMENTO DEGLI OBIETTIVI ALLA DISPERSIONE NEL FULL RANGE

Dunque gli obiettivi per fotocamere contengono, tra vari altri, alcuni accorgimenti per ridurre il fenomeno della dispersione. Cioè sono ottimizzati per presentare la minima aberrazione cromatica nella banda del visibile. Ma cosa succede se la banda elettromagnetica interessata diventa molto più grande, dai 300 ai 1.000 nanometri come nella variante Full Range? Bene, succede che con il variare della lunghezza d'onda (ultravioletto, visibile, infrarosso) sarà necessario modificare la messa a fuoco, ed inoltre che l'uso della fotocamera senza alcun filtro sull'obiettivo che limiti la banda di lavoro, produrrà delle immagini che presenteranno sempre un po’ di “morbidezza” perché i contribuiti alle varie lunghezze d'onda non potranno essere tutti a fuoco contemporaneamente.

Anche nel caso di una banda così larga è possibile approntare accorgimenti che limitino la dispersione. Questo viene fatto, ad esempio, sulle sonde di radianza di spettroradiometri a banda larga, come quello che utilizziamo nel nostro laboratorio, ma il costo di tali ottiche diventerebbe assolutamente proibitivo per un uso anche professionale, ed in più non sarebbe possibile raggiungere quelle luminosità cui gli obiettivi professionali ci hanno abituato.

RIVESTIMENTI ANTIRIFLESSO

Qua va fatta una ulteriore considerazione che riguarda i rivestimenti antiriflesso di cui alcune lenti degli obiettivi sono dotate. L'utilizzo del “coating”, come tecnicamente in modo anglofono viene chiamato il rivestimenti antiriflesso, ha fondamentalmente due scopi: ridurre fastidiosi riflessi tra lente e lente, e tra lente e sensore, ed aumentare la trasparenza complessiva dell'obiettivo, e quindi la sua luminosità. Cioè l'antiriflesso riduce drasticamente la quantità di luce che raggiungendo la superficie rimbalzerebbe altrove, “convogliandone” all'interno la massima parte. Purtroppo più è larga la banda di lunghezze d'onda di cui si vuole limitare il riflesso, più complessi sono lo studio e la deposizione del film sottile che ricopre le lenti, e la caratteristica dell'antiriflesso è quella di manifestare un comportamento esattamente opposto appena si va oltre la banda per la quale è stato studiato.

Detto in altre parole, se un obiettivo presenta una ottima caratteristica di antiriflesso nel visibile, è probabile che presenti più riflessi del dovuto nella bande adiacenti, cioè gli ultravioletti e gli infrarossi. Nella scelta degli obiettivi per operare in Full Range questo ha una notevole importanza, e non ha nulla a che fare con la bontà degli obiettivi, anzi può succedere che obiettivi ottimi nel visibile non lo siano altrettanto nel Full Range.

Fino ad oggi l'obiettivo che a noi non ha mai dato un solo problema è l'AF-S VR Micro-Nikkor 105mm f/2.8G IF-ED, che si comporta egregiamente a tutte le lunghezze d'onda senza mai produrre alcun alone o riflesso spurio, nonostante le sue 14 lenti ripartite in 12 gruppi.

Diversamente l'AF-S Nikkor 24-70mm f/2.8G ED, quando usato a focali corte, presenta nella seconda banda infrarossi (IR2) una luminosità centrale non equilibrata con il resto della inquadratura, alterando di fatto l'uniformità di esposizione, anche se di poco.

SISTEMA AUTOFOCUS

Nelle fotocamere reflex dotate di Live View i sistemi di messa a fuoco sono due: uno tradizionale basato su prismi, come quello a linea spezzata presente nelle vecchie fotocamere, ed uno basato sul microcontrasto dell'immagine che si forma sul sensore quando è in funzione il Live View.

Il secondo sistema è praticamente infallibile ed indipendente dalla lunghezza d'onda alla quale si sta riprendendo, perché agisce sulla messa a fuoco dell'obiettivo fino a quando l'immagine diventa a fuoco proprio sul piano di ripresa, quello del sensore. L'unico limite è che ha bisogno di una sufficiente luminosità per essere efficiente. Il primo invece, non analizza l'immagine sul piano del sensore e quindi richiede una taratura su di un piano a distanza equivalente (un po’ come la messa a fuoco a mano sul vetrino di messa a fuoco che vediamo nell'oculare). Ma questo sistema prevede che il cammino ottico sia sempre lo stesso, cosa che invece non è vera per la variante Full Range in quanto con l'ampia variabilità della lunghezza d'onda il cammino ottico può cambiare anche significativamente (vedi Figura 9). Nel Full Range convenzionalmente quindi il sistema AF viene ritarato, dopo la modifica ottica, per funzionare correttamente nel visibile, come per la fotocamera standard non modificata. In questo modo, utilizzando un opportuno filtro davanti all'obiettivo (di cui parleremo più avanti) la fotocamera recupera integralmente tutte le sue funzioni, come se non fosse stata mai modificata.

NITIDEZZA DELL'IMMAGINE

La nitidezza dell'immagine dipende principalmente da due fattori: livello di rumore e qualità dell'obiettivo. A sua volta il livello di rumore dipende, a parità di altri fattori, come tecnologia utilizzata e dimensione del pixel, che non possono essere modificate, dal livello di sensibilità impostato.

Di nuovo ci troviamo di fronte alla questione che tutti gli obiettivi vengono ottimizzati per le lunghezze d'onda del visibile e quindi quando ci si allontana da questa banda le prestazioni possono iniziare a ridursi. La nostra esperienza pratica ci fa dire che nonostante ci si allontani abbastanza dal visibile, soprattutto nella banda degli infrarossi, le prestazioni degli obiettivi rimangono sempre alte, cioè al livello analogo a quelle nella zona del visibile (a parte eventuali fenomeni di riflesso di abbiamo già parlato).

RUMORE DEL SENSORE

Il rumore del sensore dipende da diversi fattori, tra cui la tecnologia utilizzata (c'è differenza ad esempio tra sensori CCD e sensori CMOS, dove questi ultimi sono meno rumorosi soprattutto alle basse luminosità), la dimensione dei pixel e la sensibilità utilizzata. Parametri fotografici sul tema di rumore in correlazione alla risoluzione sono reperibili sul sito DxOMark.

Non cambiando il primo ed il secondo fattore, intrinsecamente legati alla costruzione del sensore, rimane da valutare il terzo, il quale è a sua volta direttamente collegato alla sensibilità spettrale della fotocamera. Si può notare dal diagramma della sensibilità spettrale (Figura 7) che uscendo dalla zona della luce visibile le sensibilità dei tre canali di Bayer diminuiscono di un fattore fino a 10. Ma va fatta una considerazione: nella zona del visibile i tre canali di Bayer non possono essere miscelati per non perdere l'informazione cromatica, al di fuori del visibile, decadendo la funzione della matrice di Bayer, i segnali provenienti dai tre canali possono essere uniti per ottenere due vantaggi: un segnale più robusto ed una riduzione del rumore cromatico. Sommando i canali si vede come il segnale finale aldi fuori del visibile non scende mai al di sotto di 1/5 del segnale massimo nei tre canali RGB nel visibile. In termini fotografici vuol dire che la distanza tra il visibile e le bande esterne non raggiunge i 3EV, ed è facilmente colmabile esposimetricamente senza modificare gli ISO.

Sistema di illuminazione ed esposizione in Full Range

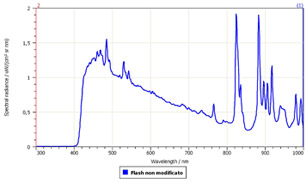

Se vogliamo lavorare con una fotocamera Full Range, per prima cosa dobbiamo procurarci una fonte di illuminazione in grado di fornire energia su uno spettro così ampio, con una distribuzione di energia abbastanza elevata ed omogenea dagli ultravioletti agli infrarossi. Una ottima soluzione è quella di utilizzare i flash Nikon SB-910, ma dopo avere rimosso il gruppo ottico anteriore costituito da due lenti di fresnel. Lo spettro di emissione risultante, come si vede dalla Figura 13, è davvero ottimo fornendo maggiore energia proprio dove la fotocamera FR ha meno sensibilità.

Non ci sono molte alternative a questo tipo di illuminazione. Una illuminazione mista, ad esempio alogena + lampada di wood, comporta immancabilmente spettri disuniformi nella illuminazione perché, a meno di posizionare le sorgenti così lontane da considerarle coincidenti, i due fasci di luce non avranno mai la stessa distribuzione, generando quindi zone con composizione spettrale diversa, utile solo a ricavare informazioni completamente sbagliate dalle immagini.

|

Spettro di emissione SB-910 standard

Nikon SB-910 standard

|

Spettro di emissione SB-910FR

|

|

|

Nikon SB-910FR

(e gruppo ottico rimosso) |

Per quanto riguarda l'esposizione, ovviamente l'esposimetro interno della fotocamera non potrà essere più di aiuto, se non quando si utilizza di nuovo la fotocamera nel visibile, ma rimane di fondamentale aiuto l'analisi dell'istogramma, soprattutto quello RGB. È infatti fondamentale che in nessuna banda e per nessuno dei tre canali RGB si verifichi mai una saturazione. Attenzione perché l'istogramma “bianco” è una media dei tre istogrammi RGB e potrebbe mascherare la saturazione di uno di questi canali. La Nikon D800 è dotata della utilissima funzione istogramma RGB selettivo per la zona ingrandita sullo schermino posteriore, che permette una analisi dettagliata dell'immagine.

Specializzazione della fotocamera Full Range: i filtri ottici per banda di interesse

Ora che abbiamo un sensore a banda larga ed un sistema di illuminazione adeguato, cosa possiamo farci?

Distinguiamo subito un uso della fotocamera dove mettiamo insieme più scatti dello stesso soggetto fatti con filtri diversi, da quello con uno scatto singolo. Il primo modo è più complesso e comporta conoscenze ed attrezzatura di livello superiore, mentre il secondo è più immediato e non richiede particolari elaborazioni.

SINGOLO SCATTO E FILTRI OTTICI

Uno scatto singolo in genere viene fatto per esplorare una banda specifica, esterna al visibile (altrimenti non avremmo bisogno di una Full Range). La specializzazione della fotocamera in una banda può avvenire o per utilizzo di un filtro passa banda oppure utilizzando una illuminazione limitata alla nostra banda di interesse. Quest'ultimo modo pone forti limitazioni, non solo per la necessità di reperire una sorgente di illuminazione con la banda desiderata, ma anche perché richiede che quella sorgente sia l'unica presente, e quindi che si lavori praticamente in camera oscura. Inoltre ovviamente sarà impossibile fare fotografie in esterno con questo metodo.

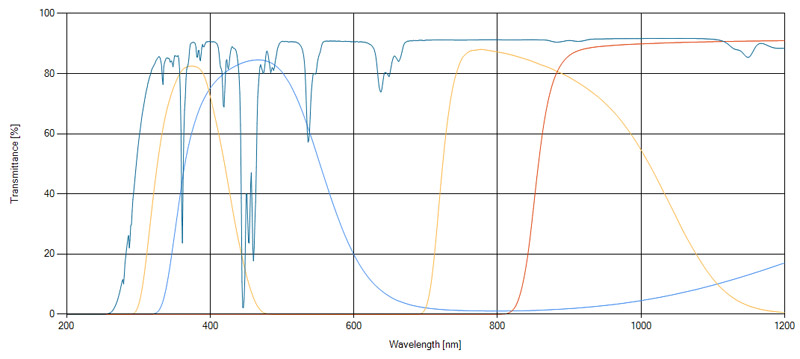

I filtri possono essere passa-banda, cioè limitare la sensibilità della fotocamera da una lunghezza d'onda ad un'altra, multi-passa-banda, quando lasciano passare contemporaneamente lunghezze d'onda appartenenti a più zone dello spettro, passa-lungo quando lasciano passare da una certa lunghezza in su, ed elimina banda o bande, quando impediscono il passaggio di illuminazione in una o più bande contemporaneamente.

|

|

|

|

|

passa-banda

|

multi-passa-banda

|

passa-lungo

|

elimina-banda

|

Il grafico che caratterizza un filtro si chiama trasmittanza spettrale e racconta, al variare della lunghezza d'onda, la percentuale di energia che il filtro lascia passare. Se si uniscono due filtri, avvitandoli ad esempio uno sull'altro, si ottiene un filtro complessivo la cui trasmittanza è pari alle due originali moltiplicate tra di loro per ogni lunghezza d'onda. Se ad esempio a 650nm il primo filtro ha una trasmittanza del 60% ed il secondo del 40%, la loro combinazione avrà, a quella lunghezza d'onda, una trasmittanza del 24% (infatti 0,6 x 0,4 = 0,24).

Dunque anteponendo un filtro, o una combinazione di filtri davanti all'obiettivo, è possibile scattare una fotografia specializzata in una certa zona dello spettro. Il concetto di colore è legato alla luce visibile ed al funzionamento dell'occhio. Appena usciamo dalla luce visibile non si può più parlare di colore ma di quanta illuminazione viene riflessa dal nostro soggetto alle lunghezze d'onda del filtro. In altre parole dovremmo avere una fotografia monocromatica, un bianco e nero, dove l'intensità del bianco indica la quantità di energia riflessa.

In pratica, anche dotando la fotocamera di un filtro passa-banda a banda stretta, otteniamo sempre una fotografia colorata. Questo è dovuto al fatto che l'energia catturata contribuisce in modo diverso ai livelli dei tre canali della matrice di Bayer, e questi tre livelli vengo